Local AI iş akışları, iş analitiği, panel oluşturma ve AI destekli raporlama için giderek popüler hale geliyor.

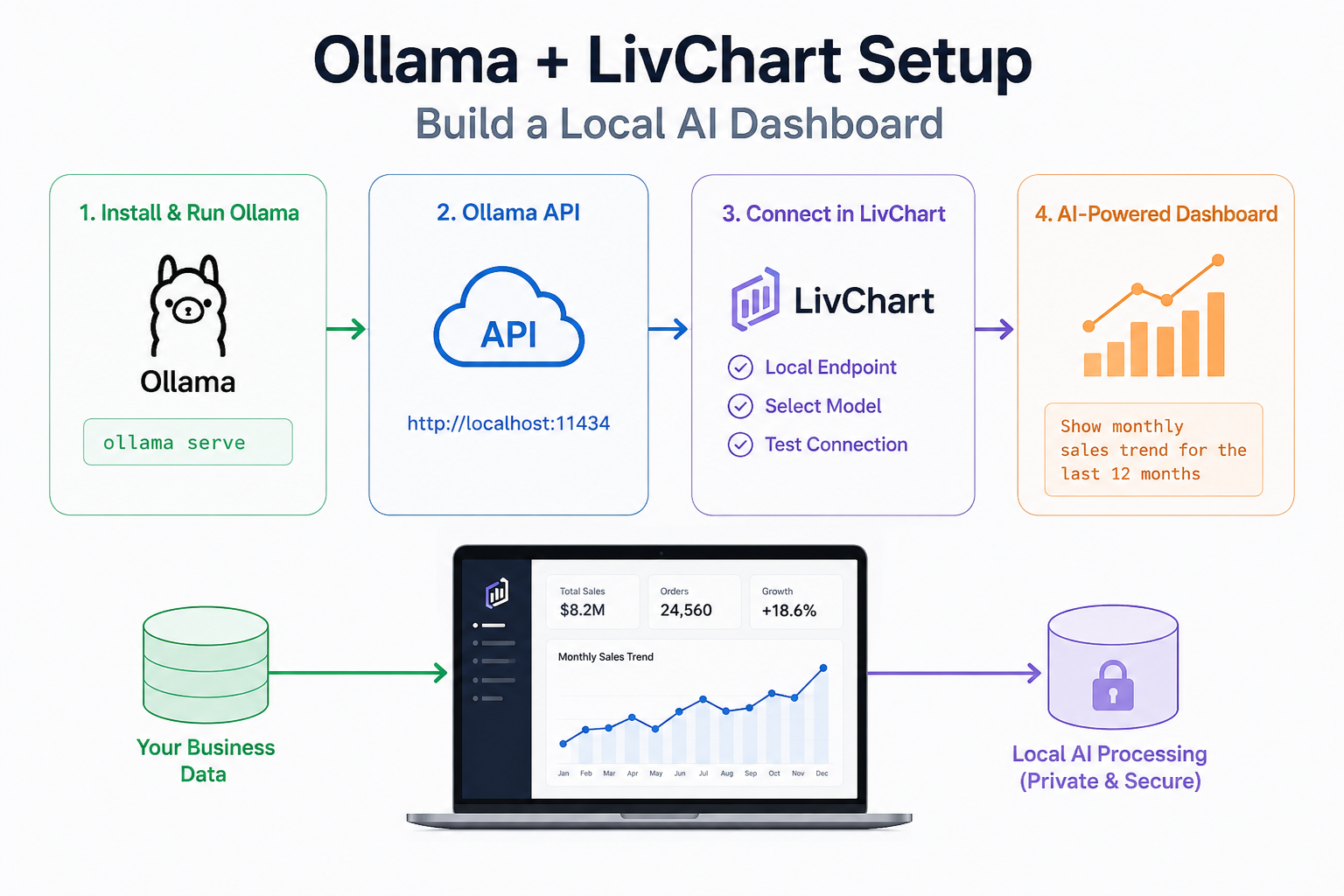

Ollama ve LivChart ile ekipler, AI modellerini yerel olarak çalıştırabilir ve dış bulut AI servislerine dayanmadan paneller oluşturabilir.

Bu rehberde şunları yapacağız:

- Ollama kurulumu

- Local AI modeli indirme

- Ollama API servisini başlatma

- Ollama'yı LivChart'a bağlama

- AI destekli panel oluşturma

- Analitik iş akışları için önerilen modelleri inceleme

Bu rehber pratik kurulum ve yapılandırmaya odaklanır.

Ne Gerekli?

Başlamadan önce şunlara sahip olduğunuzdan emin olun:

- Windows, Linux veya macOS sistemi

- En az 16 GB RAM önerilir

- Model indirmek için internet bağlantısı

- LivChart kurulu veya erişilebilir

- Temel terminal erişimi

Daha büyük modeller ve daha hızlı performans için ayrılmış bir GPU önerilir.

Adım 1 — Ollama Kurulumu

Ollama, büyük dil modellerini kendi makinenizde yerel olarak çalıştırmanızı sağlar.

macOS

Homebrew ile kurulum:

brew install ollamaLinux

Resmi kurulum betiğini çalıştırın:

curl -fsSL https://ollama.com/install.sh | shWindows

Resmi web sitesinden Ollama'yı indirin ve kurun.

Kurulumdan sonra doğrulayın:

ollama --versionAdım 2 — Local AI Modeli İndirme

Ollama kurulduktan sonra bir model indirin.

Örnek:

ollama run qwen2.5Bu komut modeli indirir ve etkileşimli bir yerel AI oturumu başlatır.

Diğer modelleri de deneyebilirsiniz:

Gemma 3

ollama run gemma3Llama 3

ollama run llama3Mistral

ollama run mistralİlk çalıştırma model boyutuna ve internet hızına bağlı olarak birkaç dakika sürebilir.

Adım 3 — Ollama API Servisini Başlatma

LivChart, Ollama ile yerel API servisi üzerinden iletişim kurar.

API sunucusunu başlatın:

ollama serveOllama varsayılan olarak şu adreste çalışır:

http://localhost:11434API'yi test edebilirsiniz:

curl http://localhost:11434/api/tagsHer şey doğru çalışıyorsa, Ollama yüklü modellerin listesini döndürür.

Adım 4 — LivChart'ı Açma

LivChart, panel ve analitik iş akışları için local AI entegrasyonlarını destekler.

LivChart'ı açın ve AI yapılandırma bölümüne gidin.

Genellikle şunları yapılandırırsınız:

- AI sağlayıcısı

- Local API uç noktası

- Model seçimi

- Bağlantı ayarları

Local Ollama uç noktasını kullanın:

http://localhost:11434Ardından yüklü modelinizi seçin.

Örnek:

qwen2.5

gemma3

llama3Yapılandırmayı kaydettikten sonra bağlantıyı test edin.

Adım 5 — İlk AI Grafiğinizi Oluşturun

LivChart Ollama'ya bağlandığında, doğal dil kullanarak grafikler oluşturmaya başlayabilirsiniz.

Örnek prompt'lar:

Satış Paneli

Son 12 ayın aylık satış trendlerini göster

Stok Analizi

Depoya göre düşük stoklu ürünlerin grafiğini oluştur

Gelir Karşılaştırması

Çeyreklik gelir ve giderleri karşılaştır

Üretim Analitiği

Makineye göre üretim duruş sürelerini görselleştir

LivChart, prompt'larınıza dayalı panel bileşenleri ve grafikler oluşturur.

Model Ollama aracılığıyla yerel olarak çalıştığından, iş akışı tamamen self-hosted olarak kalır.

Analitik İçin Önerilen Ollama Modelleri

Farklı modeller analitik iş akışlarında farklı davranır.

İşte pratik öneriler.

| Model | Hız | Türkçe Desteği | Analitik Kalitesi | Donanım İhtiyacı |

|---|---|---|---|---|

| Qwen2.5 | Yüksek | Mükemmel | Çok İyi | Orta |

| Gemma 3 | Orta | İyi | İyi | Orta |

| Llama 3 | Orta | Orta | İyi | Orta |

| Mistral | Hızlı | Orta | Orta | Düşük |

Türk iş analitiği iş akışları için Qwen modelleri genellikle özellikle iyi performans gösterir.

Sık Karşılaşılan Kurulum Sorunları

Ollama API Yanıt Vermiyor

Servisin çalıştığından emin olun:

ollama serve11434 portunun zaten kullanımda olup olmadığını kontrol edin.

Model Bulunamadı

Yüklü modelleri doğrulayın:

ollama listSık Karşılaşılan Kurulum Sorunları

Ollama API Yanıt Vermiyor

Servisin çalıştığından emin olun:

ollama serve11434 portunun zaten kullanımda olup olmadığını kontrol edin.

Model Bulunamadı

Yüklü modelleri doğrulayın:

ollama listGerekirse eksik modeli tekrar indirin.

Yavaş Performans

Büyük modeller şu gereksinimlere ihtiyaç duyabilir:

- Daha fazla RAM

- GPU hızlandırma

- Daha küçük nicelemmiş modeller

Daha hızlı panel oluşturma için daha hafif modeller de deneyebilirsiniz.

Güvenlik Duvarı veya Yerel Ağ Sorunları

Bazı işletim sistemleri yerel API erişimini engeller.

Şunları doğrulayın:

- localhost erişimine izin verildiği

- güvenlik duvarı kurallarının 11434 portuna izin verdiği

- güvenlik yazılımının Ollama'yı engellemediği

Önerilen Donanım

Hafif analitik iş akışları için:

- Modern CPU

- 16 GB RAM

Daha büyük AI panelleri için:

- NVIDIA GPU önerilir

- 32 GB+ RAM

- SSD depolama

GPU hızlandırma, grafik oluşturma hızını ve yanıt sürelerini önemli ölçüde iyileştirebilir.

Örnek Local AI Analitik İş Akışı

Tipik bir kurulum şöyle görünebilir:

- İş verileri LivChart'a girer

- Ollama prompt'ları yerel olarak işler

- AI grafikler ve panel önerileri oluşturur

- Kullanıcılar analitiği etkileşimli olarak iyileştirir

- Paneller şirket altyapısı içinde kalır

Bu yaklaşım, AI destekli analitiği yerel altyapı esnekliğiyle birleştirir.

Sonuç

Ollama ve LivChart, local AI destekli panel sistemleri oluşturmak için pratik bir yol sunar.

Kuruluşlar, tamamen dış bulut AI servislerine dayanmak yerine modelleri yerel olarak çalıştırabilir ve doğrudan analitik iş akışlarına entegre edebilir.

Self-hosted AI panellerini keşfeden ekipler için bu kurulum şunları sunar:

- yerel AI işleme

- esnek model seçimi

- AI destekli grafik oluşturma

- azaltılmış bulut bağımlılığı

- tamamen özelleştirilebilir analitik iş akışları

Local AI benimsenmesi büyümeye devam ettikçe, Ollama ve LivChart'ı birleştirmek kuruluşların kendi altyapılarını kullanarak daha hızlı ve daha esnek analitik ortamlar oluşturmasına yardımcı olabilir.